无论您所从事的是前沿AI模型的研究、新一代人工智能应用的开发,或是复杂的优化模拟,这一新版本都为您提供了在性能、效率、可扩展性方面的高度提升。在本期博客中,我们将深入探讨此次发布的5大核心功能提升,这些提升与功能的增强成就了这一版本的变革性,从而巩固了AMD ROCm作为人工智能和高性能计算开发平台的领先地位。

1、在ROCm 6.2中扩展了vLLM支持——提升了AMD Instinct™加速器的AI推理能力

AMD 正在扩展对vLLM的支持,以提升AMD Instinct™加速器上AI模型的效率和可扩展性。vLLM专为大语言模型(LLMs)所设计,解决了关键的推理难题,例如,高效的多GPU并行运算、降低内存使用资源、最小化计算瓶颈。客户可通过ROCm文档中所提供的步骤来启用vLLM中的各个上游功能,例如:多GPU并行运算、FP8 KV缓存(推理)等,以应对开发中的相关难题。若要触及到尖端的功能特性,ROCm/vLLM分支还提供了高级实验功能,例如:FP8 GEMMS(使用8位浮点数的数据类型进行矩阵乘法运算)、“自定义解码分页注意力”机制。需要使用这部分功能,请按照此处提供的步骤进行操作,并在克隆git仓库是选择rocm/vllm分支。或通过专用的Docker文件获取(点此获取)。

随着ROCm 6.2版本的发布,AMD Instinct™的新、老用户可以自信地将vLLM集成到AI流水线中,享受最新功能所带了的性能和效率的提升。

2、ROCm中的Bitsandbytes量化技术支持——提升AMD Instinct™的AI训练和推理能力,增强内存效率与性能

AMD ROCm所支持的Bitsandbytes量化库为AI开发带了革命性的变化,使得AMD Instinct™ GPU加速器上的内存效率和性能有了显著提升。利用8位优化器可减少在AI训练过程中对内存的占用,使得开发者可在有限的硬件资源下处理更复杂的模型。“LLM.Int8()”这一量化技术对AI进行了优化,使大语言模型(LLMs)可部署在内存容量较小的系统中。低比特量化技术可以加速AI训练和推理,进而提升整体效率和生产力。

Bitsandbytes量化技术通过减少内存使用和计算需求,使得更多的用户可以体验到先进的AI功能,降低了使用成本,实现了AI开发的全民化,拓展了创新新机会。它所具备的可扩展性,能够在现有硬件限制内有效管理更大的模型,同时保持接近32位精度版本的准确性。

开发者可以按照此链接中的说明,轻松将Bitsandbytes与ROCm集成,以便在AMD Instinct™ GPU加速器上进行高效的AI模型训练和推理,同时降低内存和硬件要求。

3、全新的离线程序创建工具——简化ROCm的安装过程

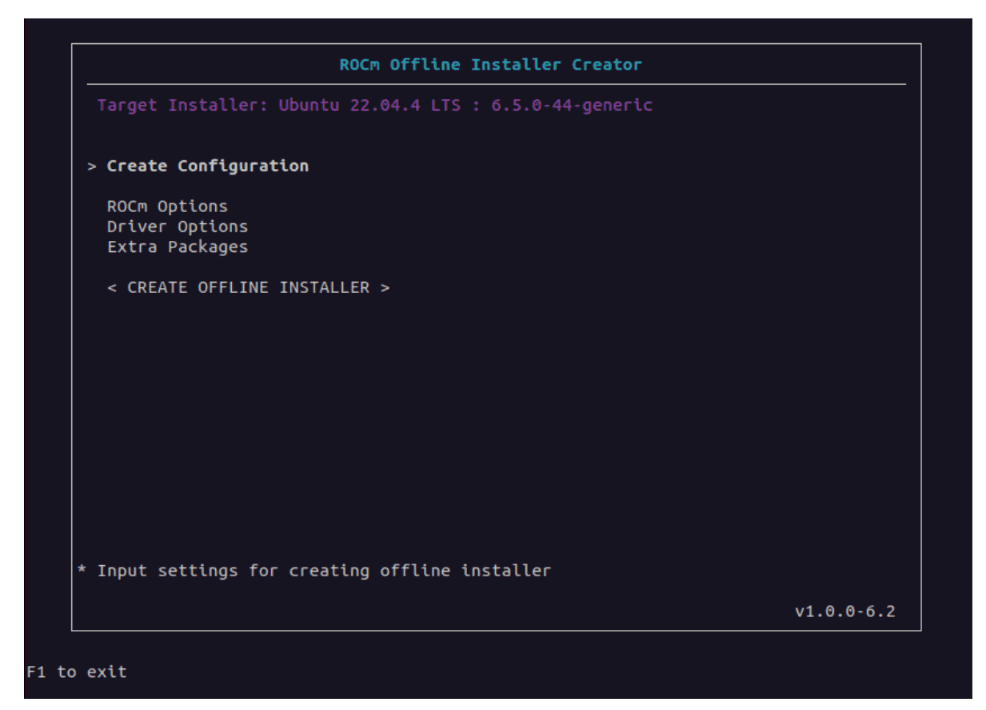

ROCm离线安装程序创建器为没有互联网访问或本地仓库镜像的系统提供了一个完整的解决方案,从而简化了安装过程。它创建了一个包含所有必要依赖项的单一安装程序文件,并提供了一个用户友好的图形界面,允许轻松选择ROCm组件和版本,从而使部署变得简单直接。该工具通过将功能集成到一个统一的界面中,降低了管理多个安装工具的复杂性,提高了效率和一致性。此外,它还自动化了安装后的任务,如用户组管理和驱动程序处理,从而帮助确保安装的正确性和一致性。

图示:简化的ROCm安装体验——使用离线安装程序创建器图形界面

ROCm离线安装程序创建器从AMD仓库和操作系统包管理器中下载并打包所有相关文件,有助于确保安装过程正确且一致,从而降低出错风险并提高系统整体稳定性。它非常适合没有互联网访问的系统,同时也为IT管理员提供了一个简化且高效的安装过程,使ROCm在各种环境中的部署比以往任何时候都更加容易。

4. 全新的Omnitrace和Omniperf性能分析工具(Beta版)——在AMD ROCm中引领AI(人工智能)与HPC(高性能计算)开发的变革

全新的Omnitrace和Omniperf性能分析工具(Beta版)将通过提供全面的性能分析和简化的开发工作流,引领ROCm中的AI和HPC开发革命。

Omnitrace提供了跨CPU、GPU、网络接口控制器(NIC)和网络结构的系统性能整体视图,帮助开发者识别并解决瓶颈问题,而Omniperf则提供详细的GPU内核分析以供微调。这些工具共同优化了应用程序整体和计算内核特定的性能,支持实时性能监控,有助于开发者在整个开发过程中做出明智的决策和调整。

图示:Omnitrace性能分析工具

图示:Omniperf性能分析工具

通过解决性能瓶颈问题,它们有助于确保资源得到高效利用,最终实现快速的AI训练、推理和HPC模拟。

5.更加广泛的FP8(数据处理方式)支持——通过使用ROCm 6.2增强AI推理能力

ROCm中的广泛FP8(数据处理方式)支持可以显著提升运行AI模型的进程,尤其是在推理方面,它有助于关键问题的解决,如内存瓶颈和与更高精度格式相关的高延迟问题,使得在相同的硬件限制下能够处理更大的模型或批次,从而实现更高效的训练和推理过程。此外,FP8(数据处理方式)的降低精度计算可以减少数据传输和计算中的延迟。

ROCm 6.2在其生态系统中扩展了对FP8(数据处理方式)的支持,实现了从框架到库等各个方面的性能和效率的提升。

- Transformer Engine:通过HipBLASLt,在PyTorch和JAX中增加了FP8 GEMM支持,与FP16/BF16相比,最大限度地提高了吞吐量并降低了延迟。

- XLA FP8:JAX和Flax现在通过XLA支持FP8 GEMM,以提升性能。

- vLLM集成:进一步优化了具备FP8能力的vLLM。

- FP8 RCCL:RCCL现在处理FP8特定的集合操作,扩展了其多功能性。

- MIOPEN:支持基于FP8的Fused Flash注意力机制,提高效率。

- 统一FP8标头文件:跨库标准化FP8标头文件,简化开发和集成过程。

凭借ROCm 6.2,AMD再次展示了了其为AI(人工智能)和HPC(高性能计算)领域提供强大、有竞争力且富有创新性解决方案的承诺。此版本的发布,意味着开发人员拥有了突破边界所需的工具和支持,这也进一步增强了ROCm作为下一代计算任务首选开放平台的信心。请与我们一同接纳这些进步,将您的项目提升至前所未有的性能和效率水平。